在信息爆炸的数字化时代,截图已成为记录、沟通与创作的核心手段。然而,我们常常面临一个普遍困境:从模糊的演示文稿、低像素的网页,或经过多次压缩的即时通讯对话中截取的图像,其细节和清晰度往往损失严重,难以满足专业报告、高质量文档或视觉设计的需求。传统图像放大技术(如双线性、双三次插值)只能简单地增加像素数量,结果是图像变得更加模糊和失真,无法“无中生有”地恢复丢失的纹理与边缘细节。

幸运的是,人工智能的飞速发展,特别是深度学习和卷积神经网络(CNN)在计算机视觉领域的突破,为我们带来了革命性的解决方案——AI图像超分辨率(Super-Resolution, SR)。这项技术能够智能地分析和学习高分辨率图像的内在特征与模式,从而对低分辨率输入进行“脑补”,生成细节丰富、边缘锐利的高质量放大图像。这对于依赖视觉精确性的用户群体,如设计师、开发者、学术研究者和内容创作者而言,意义非凡。

作为一款以高效、精准著称的截图工具,Snipaste的核心价值在于优化从“捕获”到“使用”的全链路体验。虽然Snipaste本身专注于提供像素级精准的截图、强大的贴图与标注功能,并确保图像的原始质量,但它同时也是一个绝佳的“图像处理枢纽”。用户完全可以截取屏幕内容后,利用外部AI工具进行超分辨率增强,再将优化后的图像导入Snipaste进行后续的标注、对比或演示。本文将深入探讨如何将AI超分辨率技术与Snipaste工作流相结合,通过详实的实验,展示如何将模糊的截图转化为清晰可用的视觉资产。

一、AI超分辨率技术核心原理与模型演进 #

要有效利用AI提升截图质量,首先需要理解其背后的基本原理。与传统的插值方法不同,AI超分辨率属于一种“基于学习的”方法。

1.1 从插值到学习:技术的范式转移 #

传统插值算法在放大图像时,新像素的颜色值仅由其周围少数几个原始像素的数学平均值决定。它没有图像内容的概念,因此无法重建高频细节(如文字边缘、纹理图案),导致结果平滑且模糊。

AI超分辨率模型则通过在海量的高-低分辨率图像对数据集上进行训练。模型学习的是一个复杂的映射函数:给定一个低分辨率图像块,它能预测出对应的高分辨率图像块应该是什么样子。这个过程本质上是在利用从数据中学到的“先验知识”进行合理的细节 hallucination(幻觉生成)。

1.2 关键神经网络架构演进 #

- SRCNN (2014):开创性地将深度学习引入超分辨率,使用一个简单的三层卷积网络学习端到端的映射,效果已优于传统方法。

- FSRCNN / ESPCN:着重于提升推理速度。ESPN提出“亚像素卷积层”,在低分辨率空间进行大部分计算,最后通过重组操作提升分辨率,极大提高了效率。

- SRGAN (2017):里程碑式的工作。首次引入生成对抗网络(GAN),在追求高像素精度(如PSNR)的同时,引入感知损失(Perceptual Loss),使生成图像在视觉观感上更加逼真、自然,即使某些像素不完全准确,但人眼看起来更舒服。

- ESRGAN (2018):SRGAN的增强版,改进了网络结构、对抗损失和感知损失,产生了更锐利的边缘和更丰富的纹理,是当前最受欢迎的实用模型之一。

- Real-ESRGAN (2021):专注于真实世界图像的超分辨率。它训练所用的退化模型更加复杂,模拟了实际中可能存在的多种模糊、噪声和压缩伪影,因此对网页截图、压缩过的JPG图片等处理效果尤为出色。

- 扩散模型 (2022至今):随着Stable Diffusion等模型的兴起,基于扩散模型的超分辨率也展现出惊人潜力,能够生成极其丰富和连贯的细节,但计算成本较高。

对于截图后处理这一具体场景,Real-ESRGAN 和 ESRGAN 因其在效果与效率上的良好平衡,成为我们本次实验的重点。

二、实验环境搭建与模型选择 #

为了将AI超分辨率无缝融入以Snipaste为核心的截图工作流,我们推荐搭建一个本地化处理环境。这既能保障敏感截图数据的隐私(与Snipaste的本地化理念一致),又能实现快速、离线的图像增强。

2.1 本地部署实战:使用Real-ESRGAN #

我们选择Real-ESRGAN作为核心工具,因为它对处理带有压缩伪影的截图特别有效。

步骤一:基础环境准备

- 安装Python(建议3.8及以上版本)。

- 安装PyTorch。请访问PyTorch官网,根据你的CUDA版本(如有NVIDIA GPU)或选择CPU版本生成安装命令。

- 通过pip安装基础依赖:

pip install opencv-python pillow numpy

步骤二:获取Real-ESRGAN

- 从GitHub克隆官方仓库:

git clone https://github.com/xinntao/Real-ESRGAN.git - 进入目录并安装所需包:

cd Real-ESRGAN && pip install -r requirements.txt

步骤三:下载预训练模型 官方提供了多个预训练模型。对于通用场景,推荐:

- RealESRGAN_x4plus.pth:通用4倍放大模型。

- realesr-animevideov3.pth:针对动漫/卡通风格视频帧优化的模型,处理一些UI界面和插画截图也可能有奇效。

将下载的

.pth模型文件放入experiments/pretrained_models/目录下。

2.2 创建简易处理脚本 #

为了简化操作,我们可以创建一个Python脚本(例如 upscale.py):

import argparse

from basicsr.archs.rrdbnet_arch import RRDBNet

from realesrgan import RealESRGANer

import cv2

import os

def upscale_image(input_path, output_path, model_name='RealESRGAN_x4plus.pth', scale=4):

"""使用Real-ESRGAN放大单张图像"""

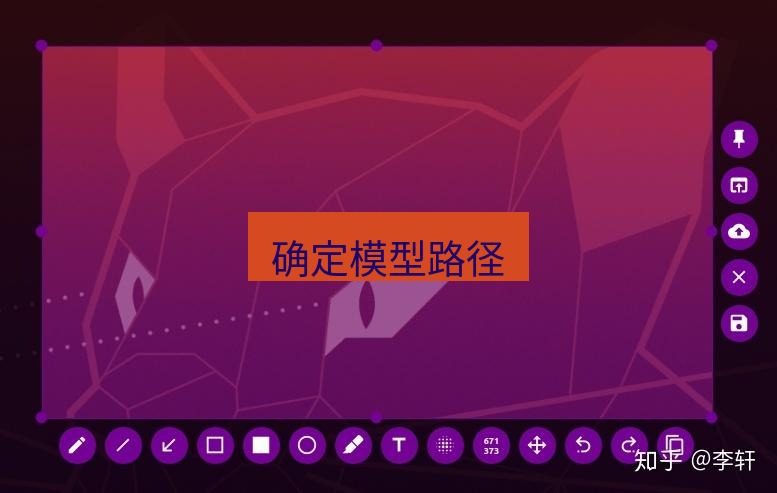

# 确定模型路径

model = RRDBNet(num_in_ch=3, num_out_ch=3, num_feat=64, num_block=23, num_grow_ch=32, scale=scale)

model_path = os.path.join('experiments', 'pretrained_models', model_name)

# 初始化增强器

upsampler = RealESRGANer(

scale=scale,

model_path=model_path,

model=model,

tile=0, # 对于截图,通常无需分块(tile)。若处理大图内存不足,可设置tile大小如400

tile_pad=10,

pre_pad=0,

half=False # 如果你的GPU支持fp16,可设为True以加速

)

# 读取图像

img = cv2.imread(input_path, cv2.IMREAD_COLOR)

# 执行超分辨率

try:

output, _ = upsampler.enhance(img, outscale=scale)

except RuntimeError as error:

print('错误:', error)

return

# 保存结果

cv2.imwrite(output_path, output)

print(f'处理完成: {input_path} -> {output_path}')

if __name__ == '__main__':

parser = argparse.ArgumentParser()

parser.add_argument('--input', type=str, required=True, help='输入图像路径')

parser.add_argument('--output', type=str, required=True, help='输出图像路径')

parser.add_argument('--model', type=str, default='RealESRGAN_x4plus.pth', help='模型文件名')

parser.add_argument('--scale', type=int, default=4, help='放大倍数')

args = parser.parse_args()

upscale_image(args.input, args.output, args.model, args.scale)

现在,你可以在命令行中运行:python upscale.py --input “模糊截图.png” --output “清晰截图.png”。

三、Snipaste与AI超分辨率整合工作流 #

拥有了本地处理能力后,我们可以设计一个高效流畅的整合工作流,让Snipaste和AI工具各司其职,发挥最大效能。

3.1 理想工作流步骤 #

- 精准捕获:使用Snipaste截取目标区域。利用其像素级窗口识别和边缘吸附功能,确保即使源内容模糊,也能获得构图精准的初始截图。对于需要捕捉的弹出菜单或动态内容,别忘了使用截图延迟功能。

- 快速评估与保存:截图后,Snipaste会立即在编辑器中打开。此时,你可以快速进行必要的标注、打码等初级处理。然后,将图像保存到本地一个指定文件夹(如

待处理截图)。 - 批量AI增强:我们可以稍微修改上面的脚本,或使用简单的批处理命令,对

待处理截图文件夹中的所有图像进行顺序处理。例如,写一个batch_upscale.py脚本,自动遍历文件夹,处理所有.png和.jpg文件,并输出到已增强截图文件夹。 - 对比与精修:这是Snipaste贴图功能大放异彩的环节。将原始模糊截图和AI增强后的清晰截图同时贴图在屏幕上。通过并排对比,你可以直观地评估增强效果。你还可以利用Snipaste的取色器对比颜色变化,或用标注工具在清晰图上圈出恢复成功的细节。关于贴图的高级技巧,例如并排对比,可以参考《Snipaste贴图混合模式详解:屏幕叠加、正片叠底等专业效果实战》。

- 最终交付:确认效果满意后,将清晰的截图最终保存,或直接通过Snipaste的剪贴板功能复制到其他应用(如Word、PPT、聊天窗口)中。

3.2 进阶技巧:自动化脚本集成 #

对于高频用户,可以追求更高程度的自动化:

- 文件系统监控:编写一个脚本(如使用Python的

watchdog库),监控Snipaste的默认保存目录。一旦有新的截图文件存入,自动触发超分辨率处理,并将结果保存到另一个目录。你几乎可以做到“截图即得高清图”。 - 与Snipaste命令行结合:虽然Snipaste本身不直接集成AI功能,但其高效的截图启动和保存能力可以与外部脚本联动。你可以创建一个快捷键,触发一个自定义脚本,该脚本依次执行:命令Snipaste截图 -> 等待用户选择区域并保存 -> 调用AI模型处理新保存的文件 -> 用图片查看器打开结果。关于Snipaste命令行的深入应用,可以阅读《Snipaste命令行参数大全:批量截图与自动化运维实战指南》。

四、多场景实测效果对比与分析 #

我们选取了几个典型的截图模糊场景,使用上述工作流进行实测,并对比不同模型的效果。

4.1 场景一:低分辨率软件界面截图 #

源问题:从一个缩放至50%显示的远程桌面或虚拟机中截取的小型软件UI界面,图标和文字边缘锯齿严重。

- 双三次插值放大4倍:文字笔画粘连,图标边缘模糊成一团,完全无法辨认。

- Real-ESRGAN (x4plus):文字轮廓被显著锐化,虽然部分极细的笔画可能仍有断裂或人工痕迹,但可读性大幅提升。图标的主体形状和内部简单纹理得到较好恢复。

- 效果分析:AI模型成功学习了“字体边缘应该锐利”、“图标具有几何形状”等先验知识。对于功能性截图(如记录软件操作步骤),此效果已完全满足要求。

4.2 场景二:重度JPEG压缩的网页图片 #

源问题:从社交媒体或老旧博客中截取的、经过多次保存压缩的JPG图片,充满色块和振铃伪影。

- 传统方法:放大后,色块和伪影同样被放大,视觉效果更差。

- Real-ESRGAN:优势场景。模型在训练时专门学习了此类退化,能有效平滑色块、抑制振铃伪影,同时尝试重建出合理的纹理。虽然无法还原完全真实的原始细节,但能获得一张视觉上干净、自然的放大图像。

- 效果分析:这体现了Real-ESRGAN“面向真实世界”设计的价值。它更注重输出“看起来舒服”的图像,而不是盲目追求像素绝对精度。

4.3 场景三:包含自然景物与文字的混合截图 #

源问题:PPT中一张包含风景背景和说明文字的幻灯片截图,整体分辨率很低。

- ESRGAN:在恢复自然纹理(如树叶、云层)方面有时比Real-ESRGAN更“大胆”,能生成更丰富的纹理细节,观感可能更生动。但有时也会产生过于夸张或不真实的图案。

- Real-ESRGAN:对自然景物的处理相对保守,更倾向于产生平滑过渡,但有时会显得细节不足。对文字的处理依然稳健。

- 效果分析:这是一个需要权衡的场景。如果重点是文字信息,选择Real-ESRGAN更安全。如果希望背景更“好看”,可以尝试ESRGAN,或准备接受其可能带来的艺术化“幻觉”。在实际操作中,不妨两种模型都试试,利用Snipaste贴图功能快速对比选择。

五、局限性、伦理考量与未来展望 #

5.1 技术局限性 #

- 无法创造不存在的信息:AI超分辨率是“有根据的猜测”。如果源图像中某个细节因分辨率过低而完全丢失(例如一个4x4像素的文字),AI也无法准确还原它,可能会生成一个看似合理但错误的字符。

- 计算资源消耗:处理高分辨率或批量图片需要一定的GPU内存和计算时间,在低端硬件上可能不够实时。

- 模型特异性:没有“万能模型”。针对动漫、人脸、文档的专用模型可能在特定领域效果更好,但通用性会下降。需要根据截图内容选择模型。

5.2 隐私与伦理考量 #

- 本地处理优先:本实验倡导的本地部署方案,与Snipaste强调的隐私保护理念高度契合。你的截图数据无需上传至任何第三方服务器,杜绝了隐私泄露风险。我们强烈建议用户优先选择本地AI工具,正如在《Snipaste隐私安全白皮书:深度解析本地数据处理与零信任架构设计》中所阐述的,本地化是保障敏感屏幕信息安全的基石。

- 谨慎用于证据性图像:在司法、新闻等对图像真实性要求极高的领域,经AI增强的图像可能引入非原始信息,需谨慎使用,并明确标注处理过程。

5.3 未来展望:与截图工具的深度集成想象 #

展望未来,AI超分辨率有望与截图工具产生更深度的融合:

- 内置智能增强选项:截图工具或许可以在保存对话框中提供一个“AI增强”复选框,用户选择后,工具在后台调用一个轻量化的本地模型进行快速处理。

- 自适应模型推荐:工具可集成一个小型分类器,自动识别截图内容类型(文字界面、自然图像、图表等),并推荐或自动应用最合适的超分辨率模型。

- 实时预览:在截图编辑器中,提供一个“增强预览”滑块,用户滑动时实时看到不同增强强度的效果,实现交互式优化。

常见问题解答 (FAQ) #

Q1: 使用AI超分辨率处理截图,会导致文件体积暴增吗? A: 是的,这是必然的。一张500x300的截图,放大4倍后会变成2000x1200,像素数量变为原来的16倍。如果保存为无损的PNG格式,文件大小可能会增加10倍以上。建议根据最终用途权衡:用于印刷或高清展示需保留大文件;用于网页或文档嵌入,可在AI增强后,再用Snipaste或其它工具进行有损压缩(JPG)以控制体积。

Q2: 我没有独立GPU,能用CPU运行这些AI模型吗? A: 可以,但速度会慢很多。PyTorch完全支持CPU运行。对于处理单张截图,CPU模式在可接受时间内(几十秒到几分钟)完成是可以的。如果需要批量处理,GPU的优势将非常明显。

Q3: 除了Real-ESRGAN,还有哪些用户友好的本地AI图像增强工具? A: 有一些带图形界面的软件整合了这些模型,例如Upscayl、Waifu2x-Extension-GUI等。它们提供了更直观的操作界面和模型管理功能,适合不熟悉命令行的用户。其底层技术原理是相通的。

Q4: AI超分辨率会对截图中的文字识别(OCR)有帮助吗? A: 通常有很大帮助。模糊、小尺寸的文字是OCR精度下降的主要原因之一。在将截图送入Snipaste自带的或第三方OCR工具之前,先进行AI超分辨率处理,可以显著提升文字区域的清晰度,从而大幅提高OCR的识别准确率。这实际上构成一个强大的“截图->超分->OCR->文本”自动化流水线。

结语 #

通过本次实验,我们验证了AI图像超分辨率技术为提升低质量截图清晰度带来的巨大潜力。将Snipaste精准、高效的截图捕获与编辑能力,与本地部署的AI模型的智能增强能力相结合,构建了一条从“模糊源”到“清晰结果”的可靠生产流水线。这不仅解决了日常工作中的实际痛点,也拓展了截图工具在专业领域应用的深度。

技术的本质是延伸人的能力。Snipaste延伸了我们捕获和操控屏幕信息的能力,而AI超分辨率则延伸了我们“看清”和“修复”细节的能力。二者协同,使得每一位用户都能成为自己视觉内容的质量把控专家。我们鼓励你根据本文的指南搭建自己的实验环境,亲身体验这种“化模糊为清晰”的魔力,并探索将其融入你个性化工作流的最佳方式,让每一次截图都物尽其用,价值倍增。

正如我们在探讨《Snipaste未来技术架构展望:模块化设计与云原生趋势下的演进路径》时所言,工具的边界正在不断扩展。虽然核心功能保持专注,但通过开放生态与外部强大工具(如AI模型)的联动,Snipaste所能支撑的用户价值将持续增长。未来,或许这种联动将变得更加无缝和智能化,让我们拭目以待。

本文由Snipaste官网提供,欢迎浏览Snipaste下载网站了解更多资讯。